▶︎動画でも話してるので、文章読むのが面倒な方はこちらをみてもらえればと思います。

今回は、ComfyUIでAnimateDiff、ControlNet、IPAdapterを組み合わせた動画生成の方法について解説します。

これを読めば誰でも簡単にクオリティーの高いAI美女が作れるようになっているので興味がある人は、下のバナーをクリックして購入してみてね🎶

ComfyUIでAnimateDiff、ControlNet、IPAdapterを組み合わせた動画生成の方法について

この動画で紹介する内容は、OpenArtというサイトにあるComfyUIの設定ファイルを参考にしています。

この解説では、Google ColabでComfyUIを動作させていきます。

OpenArtやGoogle Colabへのリンクは概要欄に貼っておきますので、必要であればそちらをご確認ください。

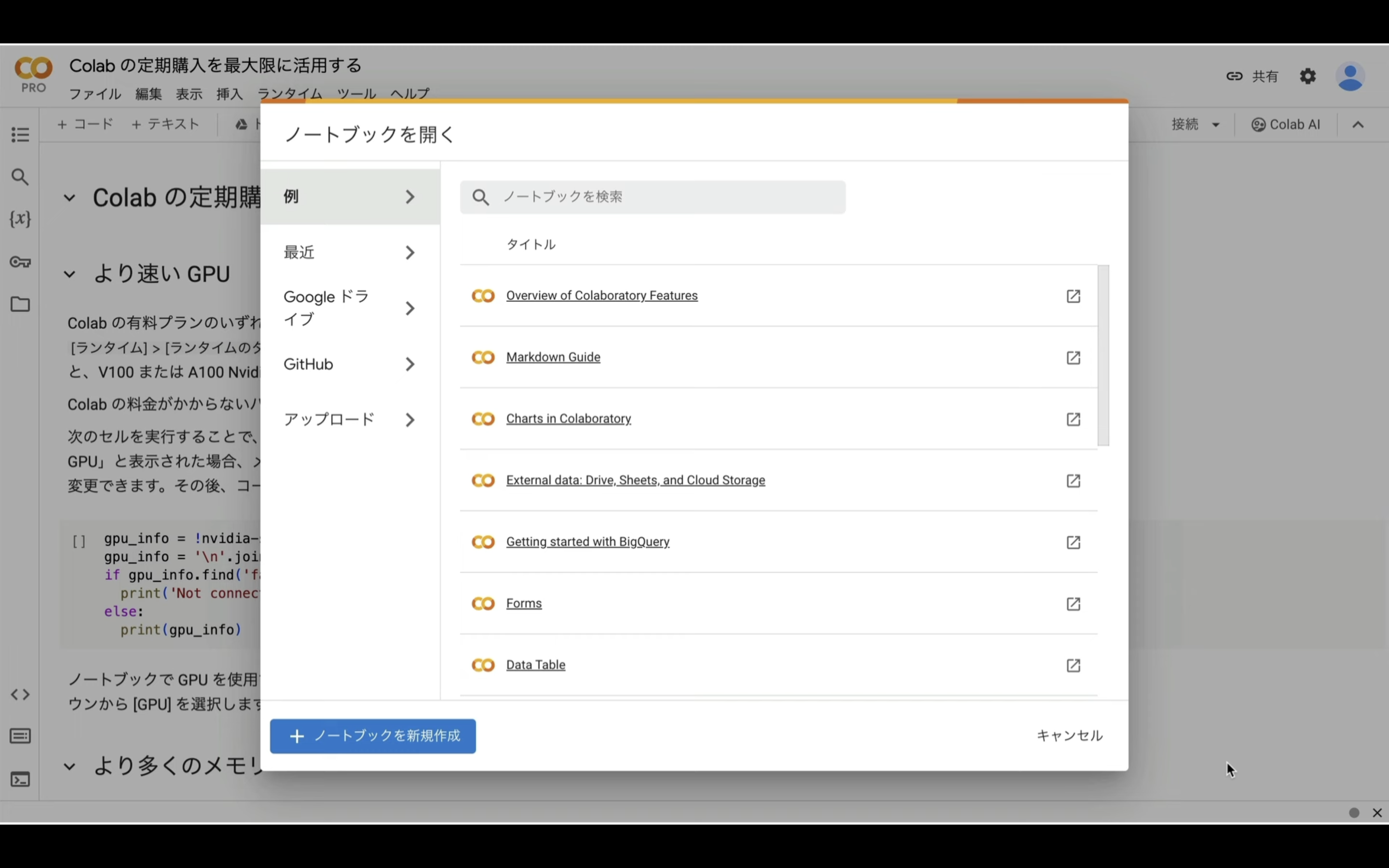

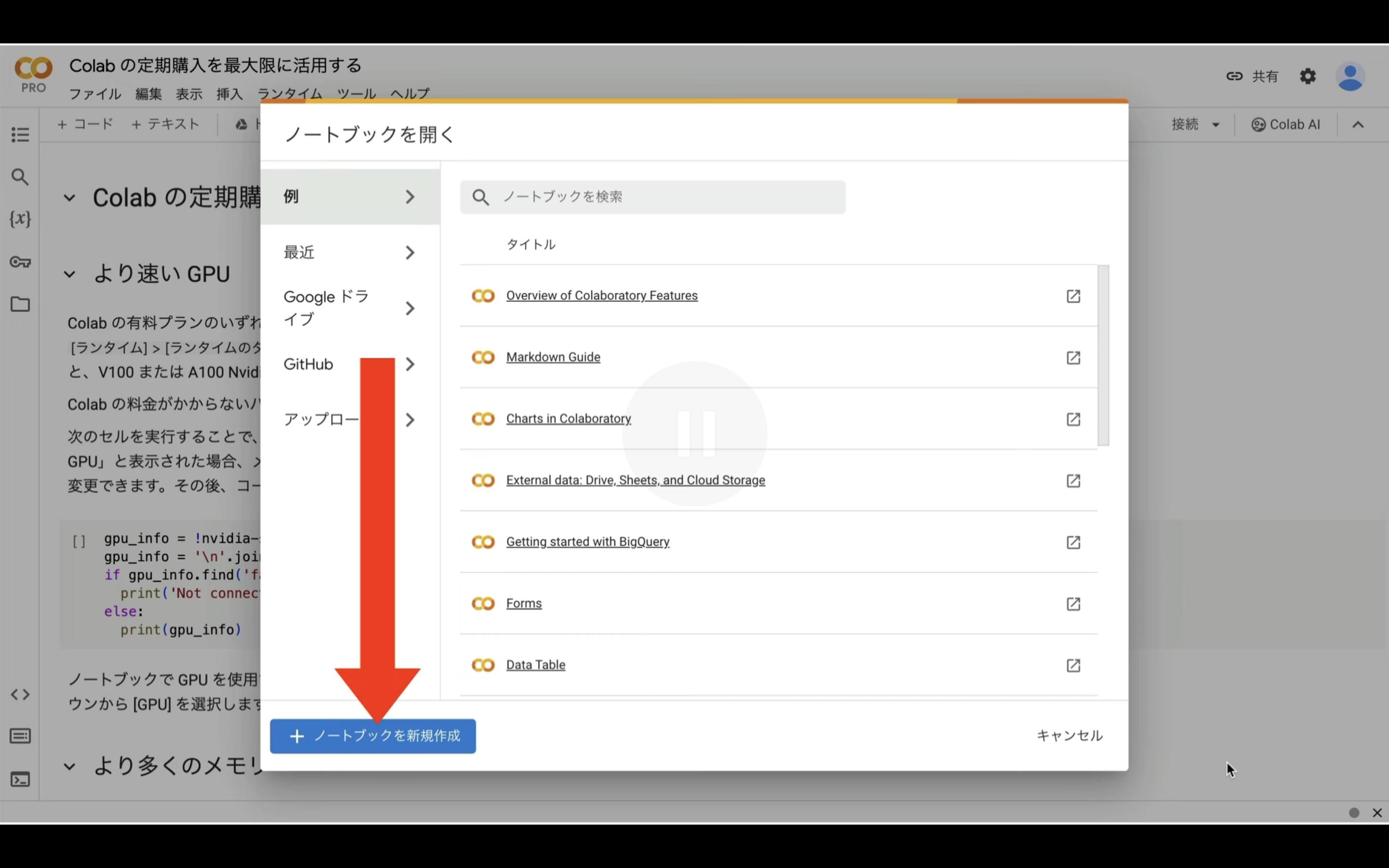

まずは、Google Colabのサイトにアクセスします。

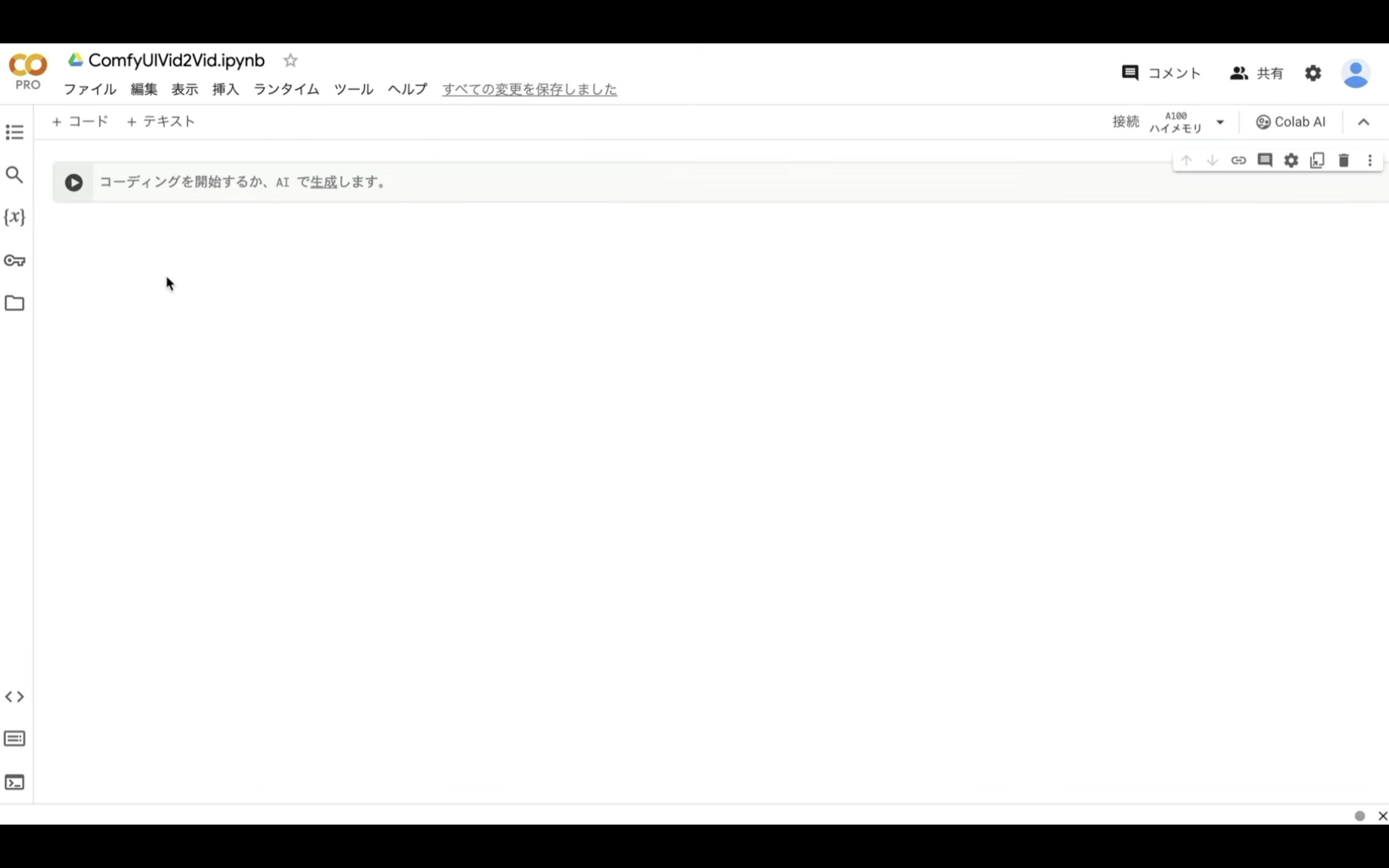

Google Colabの画面を表示したら、「新規作成」と書かれているボタンをクリックします。

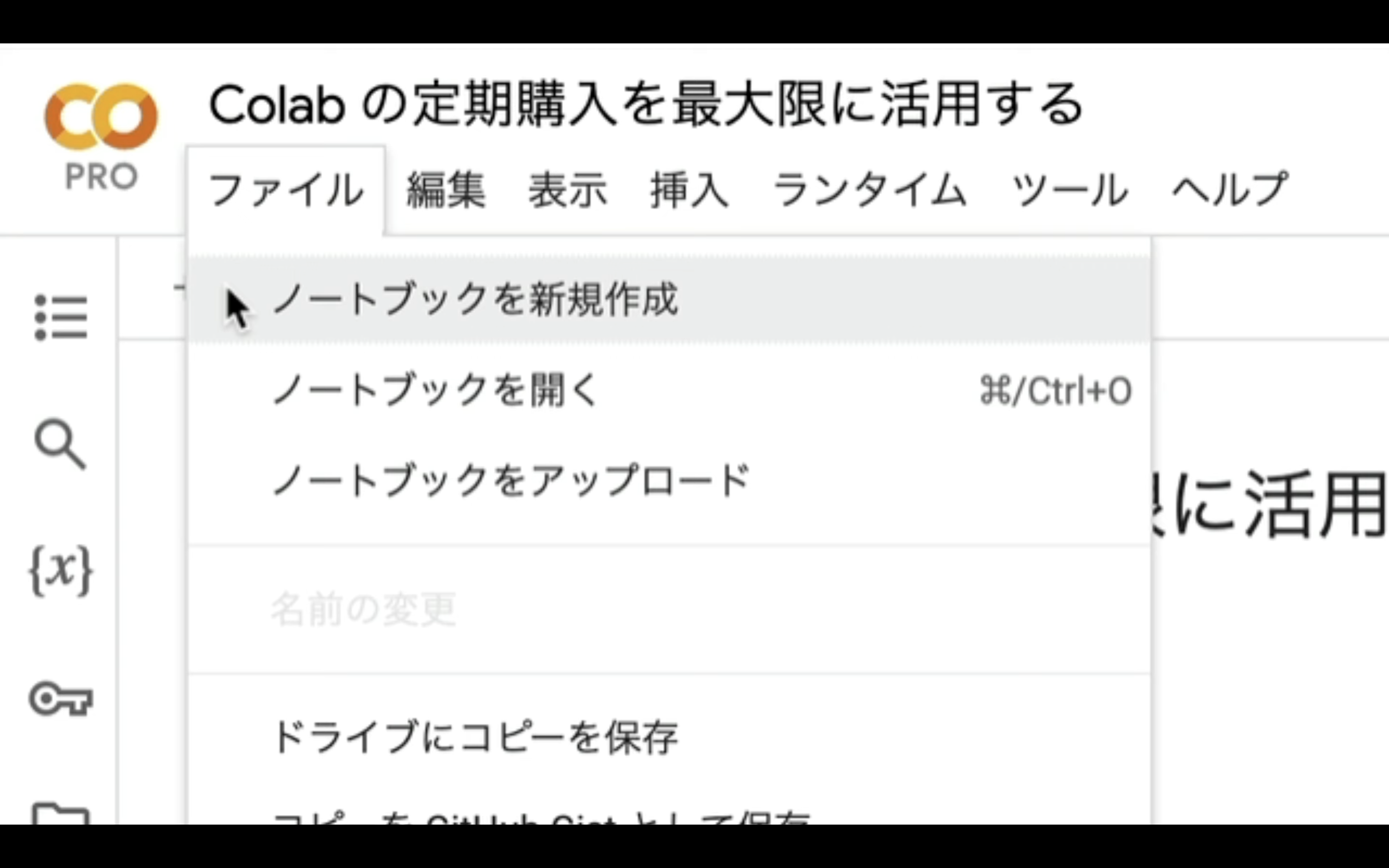

もしもこのようなポップアップ画面が表示されない場合は、メニューの中からファイルを選択し、「新規ノートブックを作成」を選択します。

ノートブックを新規作成したら、名前を変更しておきましょう。

この解説では、こんな名前にしておきました。

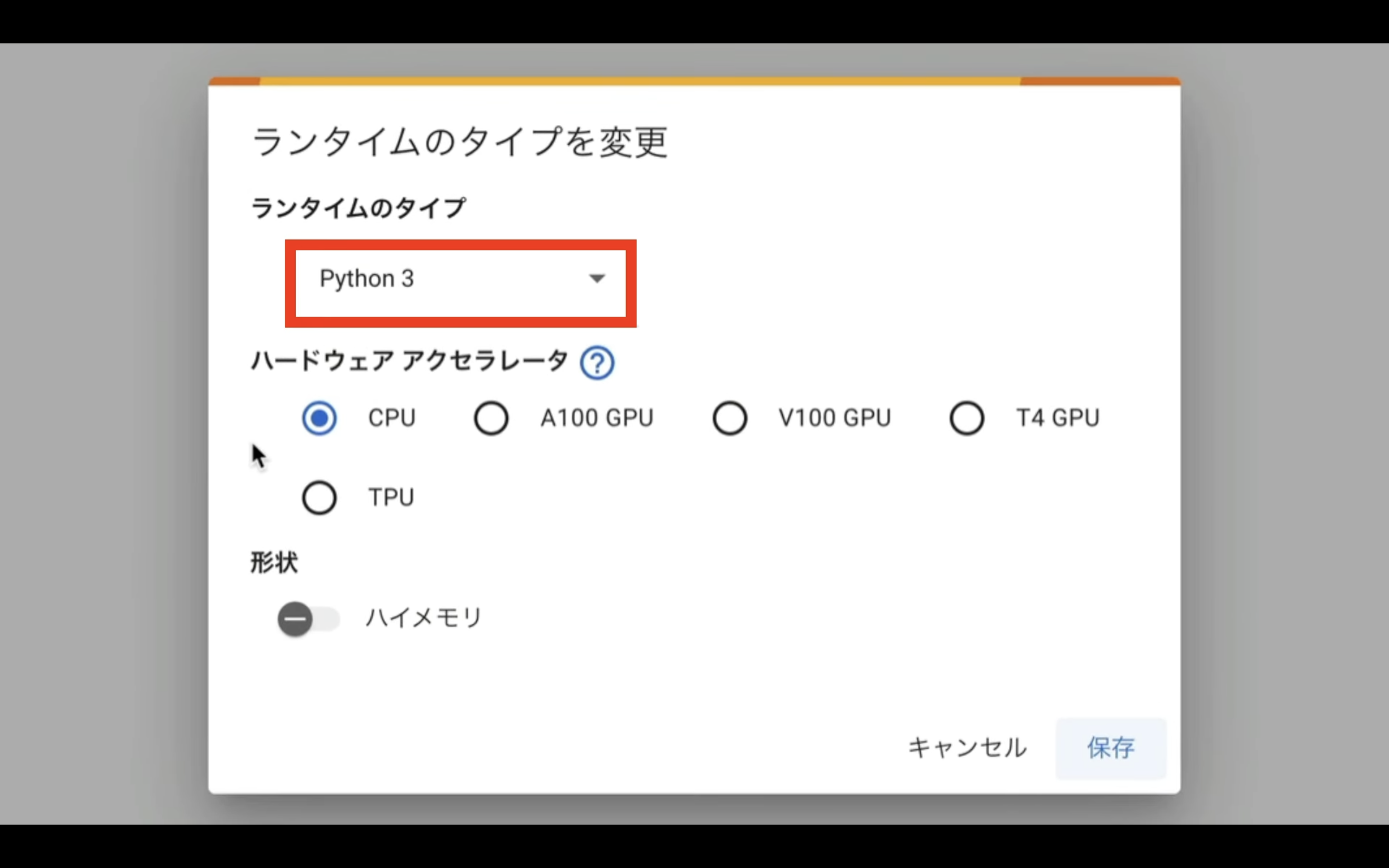

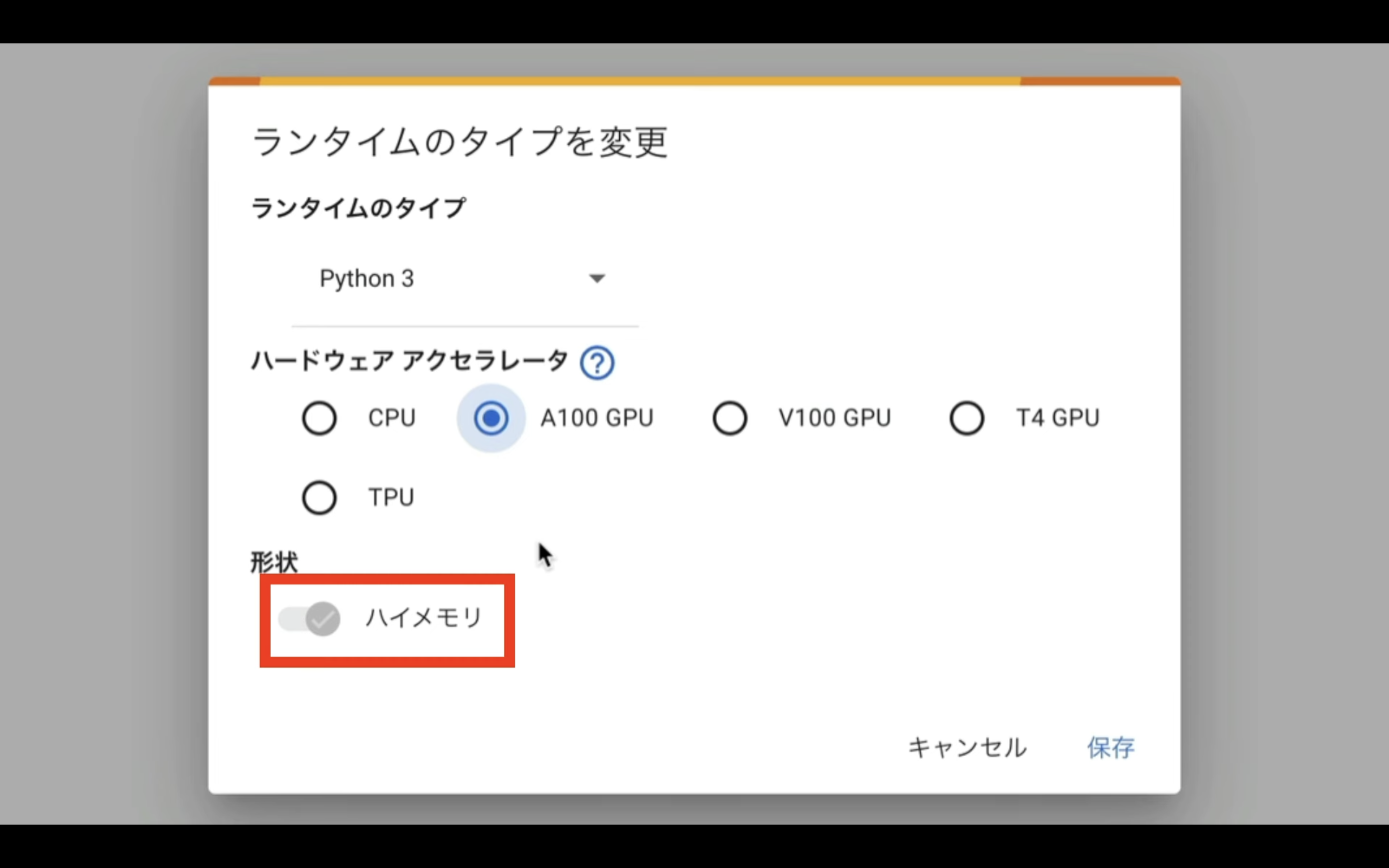

次に、ランタイムのタイプを変更します。

メニューの中からランタイムを選択し、表示された項目の中から「ランタイムのタイプを変更」を選択します。

ランタイムのタイプはPython 3にしておきます。

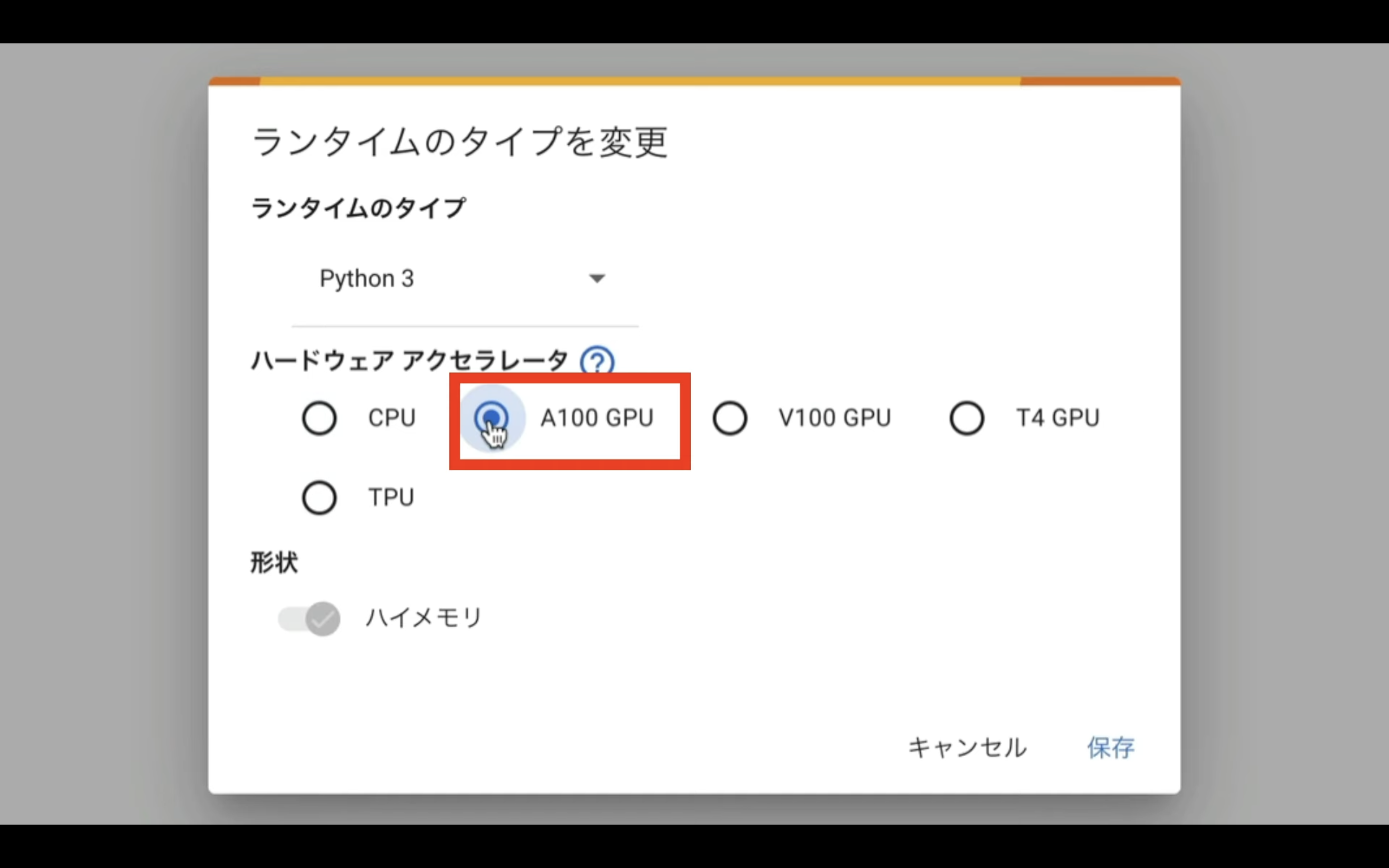

ハードウェアアクセラレーターはA100 GPUを選択しておきます。

これは、可能な限り高スペックなGPUを選択して処理時間を短くしたいためです。

なお、A100 GPUは有料版のGoogle Colabでなければ選択できません。

そのため、この動画では有料版のGoogle Colabで解説を進めます。

A100 GPUを選択すると、ハイメモリーが自動で有効になります。

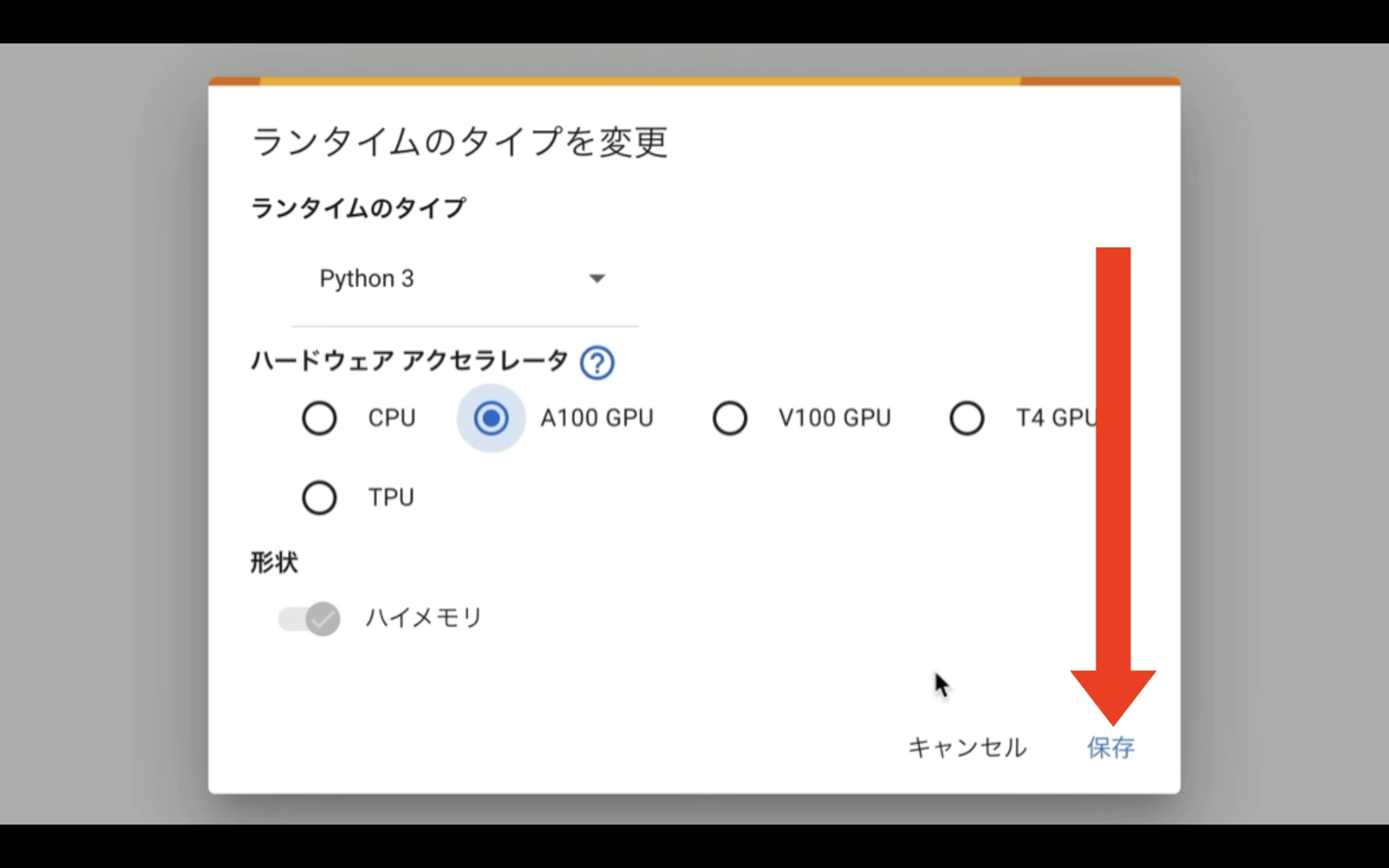

ランタイムのタイプをこのように変更したら、保存ボタンをクリックします。

これでComfyUIのソースコードを実行するための準備が整いました。

ComfyUIのソースコードを実行

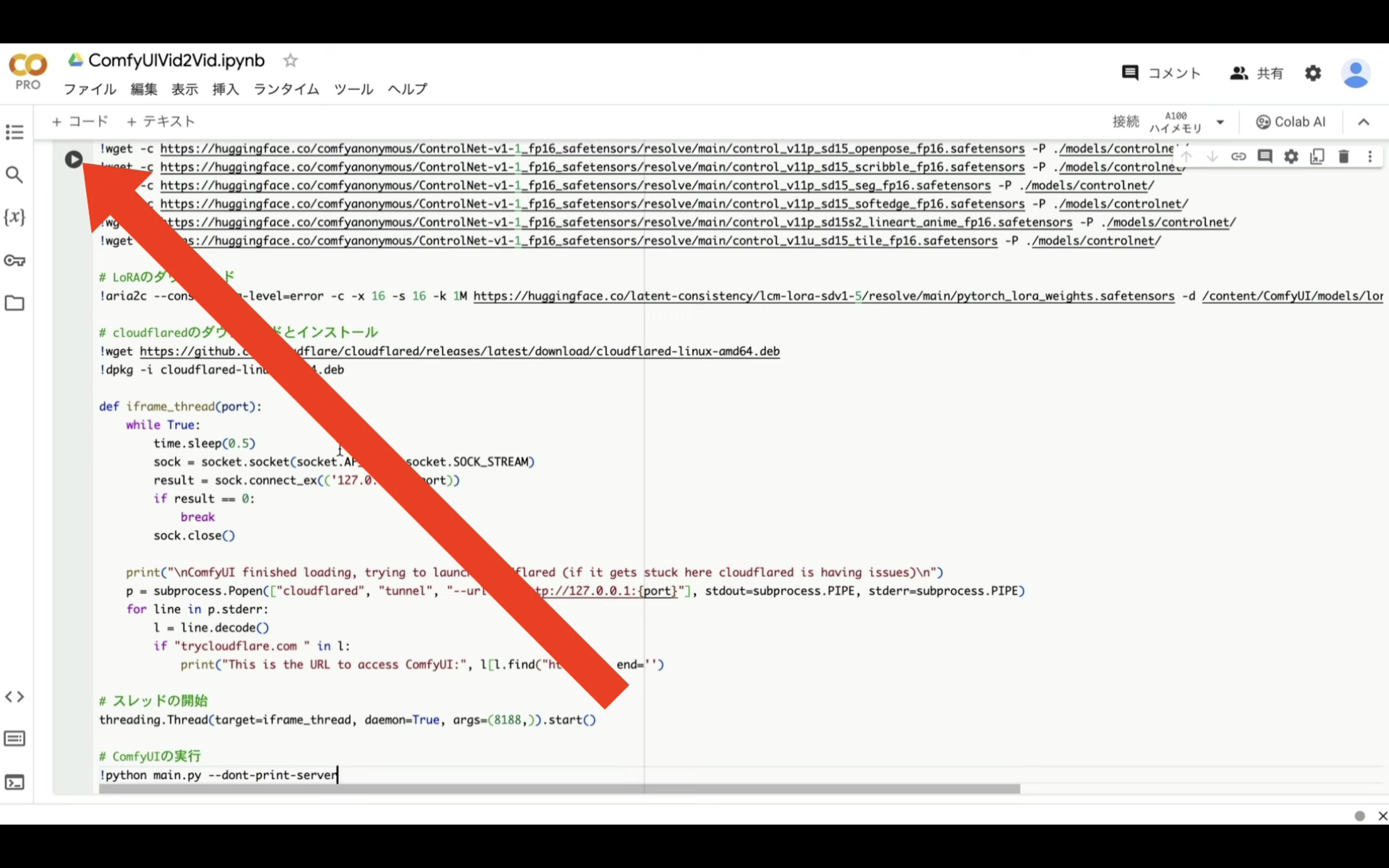

概要欄に貼ってあるテキストをコピーします。

from pathlib import Path

import subprocess

import threading

import time

import socket

!pip install -q torch==2.0.1+cu118 torchvision==0.15.2+cu118 torchaudio==2.0.2+cu118 torchtext==0.15.2 torchdata==0.6.1 --extra-index-url https://download.pytorch.org/whl/cu118 -U

!pip install -q xformers==0.0.20 triton==2.0.0 gradio_client==0.2.7 -U

!apt -y install -qq aria2

!pip install controlnet-aux==0.0.7 onnxruntime-gpu insightface

!pip install opencv-python==4.8.0.74

# 定数と設定

WORKSPACE = '/content/ComfyUI'

UPDATE_COMFY_UI = True

# ComfyUIのセットアップと更新

if not Path(WORKSPACE).exists():

%cd /content

print("-= Initial setup ComfyUI =-")

!git clone https://github.com/comfyanonymous/ComfyUI

else:

%cd $WORKSPACE

print("-= Updating ComfyUI =-")

!git pull

%cd $WORKSPACE/custom_nodes

!git clone https://github.com/Kosinkadink/ComfyUI-VideoHelperSuite

!git clone https://github.com/ssitu/ComfyUI_UltimateSDUpscale --recursive

!git clone https://github.com/TinyTerra/ComfyUI_tinyterraNodes

!git clone https://github.com/Kosinkadink/ComfyUI-Advanced-ControlNet

!git clone https://github.com/Kosinkadink/ComfyUI-AnimateDiff-Evolved

!git clone https://github.com/FizzleDorf/ComfyUI_FizzNodes

!git clone https://github.com/Stability-AI/stability-ComfyUI-nodes

!git clone https://github.com/RockOfFire/ComfyUI_Comfyroll_CustomNodes

!git clone https://github.com/ltdrdata/ComfyUI-Manager.git

!git clone https://github.com/mcmonkeyprojects/sd-dynamic-thresholding

!git clone https://github.com/Fannovel16/comfyui_controlnet_aux.git

!git clone https://github.com/cubiq/ComfyUI_IPAdapter_plus.git

!git clone https://github.com/Gourieff/comfyui-reactor-node.git

# comfyui-reactor-nodeの対応

%cd $WORKSPACE/custom_nodes/comfyui-reactor-node

!git checkout tags/v0.3.1

!git reset --hard tags/v0.3.1 #念のためhard reset

%cd $WORKSPACE/custom_nodes

!mkdir -p /content/ComfyUI/models/insightface

!aria2c --console-log-level=error -c -x 16 -s 16 -k 1M https://github.com/facefusion/facefusion-assets/releases/download/models/inswapper_128.onnx -d /content/ComfyUI/models/insightface -o inswapper_128.onnx

!mkdir /content/ComfyUI/models/facerestore_models

!aria2c --console-log-level=error -c -x 16 -s 16 -k 1M https://github.com/sczhou/CodeFormer/releases/download/v0.1.0/codeformer.pth -d /content/ComfyUI/models/facerestore_models -o codeformer.pth

!aria2c --console-log-level=error -c -x 16 -s 16 -k 1M https://github.com/TencentARC/GFPGAN/releases/download/v1.3.4/GFPGANv1.4.pth -d /content/ComfyUI/models/facerestore_models -o GFPGANv1.4.pth

!aria2c --console-log-level=error -c -x 16 -s 16 -k 1M https://huggingface.co/h94/IP-Adapter/resolve/main/models/image_encoder/model.safetensors -d /content/ComfyUI/models/clip_vision/ip_adapter -o model.safetensors

!aria2c --console-log-level=error -c -x 16 -s 16 -k 1M https://huggingface.co/embed/upscale/resolve/main/4x-UltraSharp.pth -d /content/ComfyUI/models/upscale_models -o 4x-UltraSharp.pth

!aria2c --console-log-level=error -c -x 16 -s 16 -k 1M https://huggingface.co/h94/IP-Adapter/resolve/main/models/ip-adapter-full-face_sd15.bin -d /content/ComfyUI_IPAdapter_plus/models -o ip-adapter-full-face_sd15.bin

!aria2c --console-log-level=error -c -x 16 -s 16 -k 1M https://huggingface.co/h94/IP-Adapter/resolve/main/models/ip-adapter-plus-face_sd15.bin -d /content/ComfyUI_IPAdapter_plus/models -o ip-adapter-plus-face_sd15.bin

!aria2c --console-log-level=error -c -x 16 -s 16 -k 1M https://huggingface.co/h94/IP-Adapter/resolve/main/models/ip-adapter-plus_sd15.bin -d /content/ComfyUI_IPAdapter_plus/models -o ip-adapter-plus_sd15.bin

!aria2c --console-log-level=error -c -x 16 -s 16 -k 1M https://huggingface.co/h94/IP-Adapter/resolve/main/models/ip-adapter_sd15.bin -d /content/ComfyUI_IPAdapter_plus/models -o ip-adapter_sd15.bin

!aria2c --console-log-level=error -c -x 16 -s 16 -k 1M https://huggingface.co/h94/IP-Adapter/resolve/main/models/ip-adapter_sd15_light.bin -d /content/ComfyUI_IPAdapter_plus/models -o ip-adapter_sd15_light.bin

!aria2c --console-log-level=error -c -x 16 -s 16 -k 1M https://huggingface.co/h94/IP-Adapter/resolve/main/models/ip-adapter_sd15_vit-G.bin -d /content/ComfyUI_IPAdapter_plus/models -o ip-adapter_sd15_vit-G.bin

# アニメーションモデルのダウンロード

!aria2c --console-log-level=error -c -x 16 -s 16 -k 1M https://huggingface.co/guoyww/animatediff/resolve/main/mm_sd_v15_v2.ckpt -d /content/ComfyUI/custom_nodes/ComfyUI-AnimateDiff-Evolved/models -o mm_sd_v15_v2.ckpt

!aria2c --console-log-level=error -c -x 16 -s 16 -k 1M https://huggingface.co/CiaraRowles/TemporalDiff/resolve/main/temporaldiff-v1-animatediff.ckpt -d /content/ComfyUI/custom_nodes/ComfyUI-AnimateDiff-Evolved/models -o temporaldiff-v1-animatediff.ckpt

# ネガティブプロンプト

!git clone https://huggingface.co/embed/negative $WORKSPACE/models/embeddings/negative

!wget -c -P $WORKSPACE/models/embeddings/negative/

!aria2c --console-log-level=error -c -x 16 -s 16 -k 1M https://civitai.com/api/download/models/77169 -d /content/ComfyUI/models/embeddings/negative -o BadDream.pt

!aria2c --console-log-level=error -c -x 16 -s 16 -k 1M https://civitai.com/api/download/models/77173 -d /content/ComfyUI/models/embeddings/negative -o UnrealisticDream.pt

!aria2c --console-log-level=error -c -x 16 -s 16 -k 1M https://civitai.com/api/download/models/25820 -d /content/ComfyUI/models/embeddings/negative -o verybadimagenegative_v1.3.pt

!aria2c --console-log-level=error -c -x 16 -s 16 -k 1M https://huggingface.co/h94/IP-Adapter/resolve/main/models/ip-adapter-full-face_sd15.safetensors -d /content/ComfyUI/custom_nodes/ComfyUI_IPAdapter_plus/models -o ip-adapter-full-face_sd15.safetensors

!aria2c --console-log-level=error -c -x 16 -s 16 -k 1M https://huggingface.co/h94/IP-Adapter/resolve/main/models/ip-adapter-plus-face_sd15.safetensors -d /content/ComfyUI/custom_nodes/ComfyUI_IPAdapter_plus/models -o ip-adapter-plus-face_sd15.safetensors

!aria2c --console-log-level=error -c -x 16 -s 16 -k 1M https://huggingface.co/h94/IP-Adapter/resolve/main/models/ip-adapter-plus_sd15.safetensors -d /content/ComfyUI/custom_nodes/ComfyUI_IPAdapter_plus/models -o ip-adapter-plus_sd15.safetensors

!aria2c --console-log-level=error -c -x 16 -s 16 -k 1M https://huggingface.co/h94/IP-Adapter/resolve/main/models/ip-adapter_sd15.safetensors -d /content/ComfyUI/custom_nodes/ComfyUI_IPAdapter_plus/models -o ip-adapter_sd15.safetensors

!aria2c --console-log-level=error -c -x 16 -s 16 -k 1M https://huggingface.co/h94/IP-Adapter/resolve/main/models/ip-adapter_sd15_light.safetensors -d /content/ComfyUI/custom_nodes/ComfyUI_IPAdapter_plus/models -o ip-adapter_sd15_light.safetensors

!aria2c --console-log-level=error -c -x 16 -s 16 -k 1M https://huggingface.co/h94/IP-Adapter/resolve/main/models/ip-adapter_sd15_vit-G.safetensors -d /content/ComfyUI/custom_nodes/ComfyUI_IPAdapter_plus/models -o ip-adapter_sd15_vit-G.safetensors

%cd $WORKSPACE

# 依存関係のインストール

print("-= Install dependencies =-")

!pip install xformers!=0.0.18 -r requirements.txt --extra-index-url https://download.pytorch.org/whl/cu118 --extra-index-url https://download.pytorch.org/whl/cu118

# VAEのダウンロード

!wget -c https://huggingface.co/stabilityai/sd-vae-ft-mse-original/resolve/main/vae-ft-mse-840000-ema-pruned.safetensors -P ./models/vae/

!wget -c https://huggingface.co/AIARTCHAN/aichan_blend/resolve/main/vae/BerrysMix.vae.safetensors -P ./models/vae/

#checkpointをダウンロード

!aria2c --console-log-level=error -c -x 16 -s 16 -k 1M https://civitai.com/api/download/models/130072 -d /content/ComfyUI/models/checkpoints -o realisticVisionV51_v51VAE.safetensors

#ControlNetのダウンロード

!wget -c https://huggingface.co/comfyanonymous/ControlNet-v1-1_fp16_safetensors/resolve/main/control_v11e_sd15_ip2p_fp16.safetensors -P ./models/controlnet/

!wget -c https://huggingface.co/comfyanonymous/ControlNet-v1-1_fp16_safetensors/resolve/main/control_v11e_sd15_shuffle_fp16.safetensors -P ./models/controlnet/

!wget -c https://huggingface.co/comfyanonymous/ControlNet-v1-1_fp16_safetensors/resolve/main/control_v11p_sd15_canny_fp16.safetensors -P ./models/controlnet/

!wget -c https://huggingface.co/comfyanonymous/ControlNet-v1-1_fp16_safetensors/resolve/main/control_v11f1p_sd15_depth_fp16.safetensors -P ./models/controlnet/

!wget -c https://huggingface.co/comfyanonymous/ControlNet-v1-1_fp16_safetensors/resolve/main/control_v11p_sd15_inpaint_fp16.safetensors -P ./models/controlnet/

!wget -c https://huggingface.co/comfyanonymous/ControlNet-v1-1_fp16_safetensors/resolve/main/control_v11p_sd15_lineart_fp16.safetensors -P ./models/controlnet/

!wget -c https://huggingface.co/comfyanonymous/ControlNet-v1-1_fp16_safetensors/resolve/main/control_v11p_sd15_mlsd_fp16.safetensors -P ./models/controlnet/

!wget -c https://huggingface.co/comfyanonymous/ControlNet-v1-1_fp16_safetensors/resolve/main/control_v11p_sd15_normalbae_fp16.safetensors -P ./models/controlnet/

!wget -c https://huggingface.co/comfyanonymous/ControlNet-v1-1_fp16_safetensors/resolve/main/control_v11p_sd15_openpose_fp16.safetensors -P ./models/controlnet/

!wget -c https://huggingface.co/comfyanonymous/ControlNet-v1-1_fp16_safetensors/resolve/main/control_v11p_sd15_scribble_fp16.safetensors -P ./models/controlnet/

!wget -c https://huggingface.co/comfyanonymous/ControlNet-v1-1_fp16_safetensors/resolve/main/control_v11p_sd15_seg_fp16.safetensors -P ./models/controlnet/

!wget -c https://huggingface.co/comfyanonymous/ControlNet-v1-1_fp16_safetensors/resolve/main/control_v11p_sd15_softedge_fp16.safetensors -P ./models/controlnet/

!wget -c https://huggingface.co/comfyanonymous/ControlNet-v1-1_fp16_safetensors/resolve/main/control_v11p_sd15s2_lineart_anime_fp16.safetensors -P ./models/controlnet/

!wget -c https://huggingface.co/comfyanonymous/ControlNet-v1-1_fp16_safetensors/resolve/main/control_v11u_sd15_tile_fp16.safetensors -P ./models/controlnet/

# LoRAのダウンロード

!aria2c --console-log-level=error -c -x 16 -s 16 -k 1M https://huggingface.co/latent-consistency/lcm-lora-sdv1-5/resolve/main/pytorch_lora_weights.safetensors -d /content/ComfyUI/models/loras -o lcm-lora-sdv1-5_lora_weights.safetensors

# cloudflaredのダウンロードとインストール

!wget https://github.com/cloudflare/cloudflared/releases/latest/download/cloudflared-linux-amd64.deb

!dpkg -i cloudflared-linux-amd64.deb

def iframe_thread(port):

while True:

time.sleep(0.5)

sock = socket.socket(socket.AF_INET, socket.SOCK_STREAM)

result = sock.connect_ex(('127.0.0.1', port))

if result == 0:

break

sock.close()

print("\nComfyUI finished loading, trying to launch cloudflared (if it gets stuck here cloudflared is having issues)\n")

p = subprocess.Popen(["cloudflared", "tunnel", "--url", f"http://127.0.0.1:{port}"], stdout=subprocess.PIPE, stderr=subprocess.PIPE)

for line in p.stderr:

l = line.decode()

if "trycloudflare.com " in l:

print("This is the URL to access ComfyUI:", l[l.find("http"):], end='')

# スレッドの開始

threading.Thread(target=iframe_thread, daemon=True, args=(8188,)).start()

# ComfyUIの実行

!python main.py --dont-print-server

テキストをコピーしたら、Google Colabの画面に戻ります。

テキストボックスに先ほどコピーしたテキストを貼り付け、そして再生ボタンを押します。

これで貼り付けたテキストの内容が実行されます。

この処理には5分以上かかると思います。

しばらく待っていると、このようなリンクが表示されます。

このリンクをクリックすると、ComfyUIの画面が表示されます。

この解説では、あらかじめComfyUIの設定ファイルを用意していますので、そちらをご利用ください。

下記に貼ってあるページを表示します。

このページを表示したら、「利用ファイル」と書かれているタイトルの下にあるZIPファイルをクリックします。

そうするとZIPファイルがダウンロードされるので、解凍します。

ダウンロードしたファイルを解凍したら、このようなファイルが表示されると思います。

この中にあるworkflow.JSONと書かれているファイルを、ComfyUIの画面にドラッグアンドドロップします。

ファイルは、何も表示されていない場所にドラッグ&ドロップするようにしてください。

これでworkflow.JSONの設定ファイルが読み込まれます。

設定ファイルが読み込まれたら、まず「Loader」というタイトルのブロックに元になる動画ファイルを指定します。

具体的には、「Choose Video to Upload」と書かれているボタンをクリックします。

ダイアログボックスが表示されるので、動画ファイルを指定します。

動画がアップロードされるまでしばらく待ちます。

今回はこのような動画ファイルを選択しておきました。

動画ファイルをアップロードしたら、次に服装に関する画像をアップロードします。

「ロードイメージ」というタイトルのブロックに、服装に指定したい画像をアップロードします。

「choose file to upload」と書かれているボタンをクリックします。

ダイアログボックスが表示されるので、服装に指定したい画像を選択します。

画像がアップロードされるまでしばらく待ちます。

今回はこのような服装にしてみました。

服装に関する画像をアップロードしたら、次にすり替えたい顔の画像ファイルをアップロードします。

顔の画像は、「ReActor」というテキストから始まるタイトルのブロックの近くにある「Load Image」で指定します。

「choose file to upload」と書かれているボタンをクリックします。

ダイアログボックスが表示されるので、すり替える顔の画像ファイルを選択します。

画像がアップロードされるまでしばらく待ちます。

今回はこのような画像を選択しておきました。

これで動画を生成するための準備が整いました。

それでは早速動画を生成していきましょう。

「Queue Prompt」ボタンをクリックします。

そうすると動画の生成が開始されます。

この処理には数分程度かかります。

生成処理の状況はブロックの表示で確認できます。

緑色で囲まれているブロックが現在実行されている処理です。

処理が完了すると囲んでいる緑色の表示が移動します。

現在は「ControlNet」で動画のポーズの指定の処理を行っています。

この処理だけでも5分以上かかると思います。

ControlNetの処理が完了したら、次に動画にするために1枚ずつ画像が生成されていきます。

この処理にも数分程度かかります。

画像の生成が完了したら、最後に顔のすり替え処理が実行されます。

この処理にも数分程度かかるので、しばらく待ちます。

最終的にこの緑色で囲まれている線が「Video Conbine」と書かれているブロックに移動します。

そして、生成された動画のプレビューがそのブロックに表示されます。

今回はこのような動画が生成されました。

元の動画と服装、そして顔が指定通りの動画になります。

生成された動画をダウンロードするには、プレビュー画面を右クリックします。

そして表示されたメニューの中から「Save Preview」を選択します。

これで作成した動画がパソコンにダウンロードされます。

是非お試しください。